In den Medien werden immer wieder Herausforderungen und Risiken von KI diskutiert. Es ist wichtig, dass wir die Auswirkungen von Algorithmen auf unser gesellschaftliches Leben erkennen und reflektieren.

Überblick: Um diese Themen geht es hier

Diskriminierung durch KI

KI verstärkt Polarisierung

Unternehmen sammeln Daten

Eine Frage von Macht

Fallbeispiele und Linktipps

„Du bist raus!“ – Diskriminierung Durch KI

KI-Anwendungen dienen dazu, Erkenntnisse aus Daten zu gewinnen und Entscheidungen zu treffen. Doch diese Entscheidungen können nie frei von menschlichen Einflüssen sein, denn die Anwendungen werden von Menschen programmiert. Ihre Annahmen fließen in die Software ein.

Ein Problem dabei ist: Diese Annahmen können fehlerhaft oder durch Vorurteile geprägt sein. Ein weiteres Problem besteht darin, dass KI große Datenmengen benötigt, um zu lernen. Wenn die Datengrundlage diskriminierende Muster enthält, wird auch die KI sie übernehmen. Ein Beispiel: Lebt eine Kundin oder ein Kunde einer Bank in einem ärmeren Viertel mit hoher Kriminalität, könnte die Wohnadresse dazu führen, dass die Kreditwürdigkeit herabgestuft wird – völlig unabhängig von der tatsächlichen Kreditwürdigkeit der Person. In den USA wurde KI bereits eingesetzt, um das Risiko möglicher Rückfälle bei Strafgefangenen einzuschätzen – eine Anwendung, die erhebliche Folgen für die Betroffenen haben kann und somit ethisch sehr bedenklich ist.

Auch fehlende Daten können zu Diskriminierung führen. Zum Beispiel, wenn bestimmte Gruppen in den Trainingsdaten der KI unterrepräsentiert sind. So musste sich Facebook 2021 dafür entschuldigen, dass eine für Bildanalyse eingesetzte KI Gesichter schwarzer Menschen nicht als menschliche Gesichter erkannte.

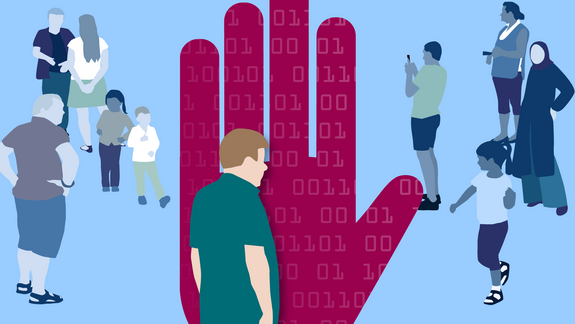

Fieser Chatbot

Mit der Künstlichen Intelligenz Tay wollte Microsoft eigentlich eine liebenswürdige Gesprächspartnerin kreieren, die von Userinnen und Usern lernt. Doch das Internet schaffte es in nur 24 Stunden, Tay in einen diskriminierenden Bot zu verwandeln.

KI verstärkt Polarisierung von Meinungen

Im Internet helfen KI-Technologien, die Flut der Inhalte zu filtern. Die Algorithmen von Suchmaschinen und sozialen Netzwerken lernen, was wichtig ist und uns interessiert. Sie passen dementsprechend an, welche Inhalte wir zu sehen bekommen. Doch das kann dazu führen, dass wir nur noch einen Ausschnitt des Informationsangebots wahrnehmen und uns in sogenannten Filterblasen bewegen.

Gleichzeitig tragen die Algorithmen dazu bei, Diskussionen in sozialen Netzwerken zu polarisieren und problematische Weltanschauungen verbreiteter erscheinen zu lassen, als sie eigentlich sind. Zum Teil ist dieser Effekt eingebaut. Denn wir beschäftigen uns eher mit Inhalten, die uns emotional bewegen. Und die Plattformen möchten, dass wir uns möglichst ausführlich mit den Beiträgen dort auseinandersetzen. Daher heben die Algorithmen auch Inhalte hervor, die wütend oder traurig machen.

Diese Mechanismen werden bereits gezielt ausgenutzt. Es gibt Beispiele dafür, dass populistische Botschaften oder Fake News verbreitet werden, um bestimmte politische Zwecke zu erreichen. Dabei können auch sogenannte Deep Fakes zum Einsatz kommen. Das sind mithilfe von KI manipulierte Inhalte, die täuschend echt wirken – zum Beispiel Videos, Bilder oder Sprachaufnahmen.

Dass KI als Instrument zur Beeinflussung eingesetzt werden kann, zeigt der sogenannte Cambridge Analytica-Skandal. Das Unternehmen arbeitete unter anderem vor den US-Wahlen 2016 für die Kampagne des damaligen Kandidaten Donald Trump. Cambridge Analytica erlangte unerlaubt Zugriff auf die personenbezogenen Daten von über 80 Millionen Facebook-Nutzerinnen und -Nutzern. Mithilfe der detaillierten Daten entwickelte es psychologische Profile, um ganz bestimmte Bevölkerungsgruppen gezielt zu beeinflussen.

Das Beispiel zeigt, dass KI-Anwendungen in den sozialen Netzwerken einen Einfluss auf die Meinungsbildung und den öffentlichen Diskurs haben können – und somit auf Grundlagen unserer Demokratie.

Unternehmen sammeln wegen KI noch mehr Daten

Einerseits haben wir ein Recht darauf, dass unsere persönlichen Daten geschützt werden. Aber: Damit KI-Anwendungen lernen und gut funktionieren können, brauchen sie möglichst viele Daten. Demnach haben Unternehmen, die KI einsetzen, kein Interesse, die Datensammlung einzuschränken – im Gegenteil. Dazu zählen auch Anbieter von Suchmaschinen und sozialen Netzwerken wie Google und Meta (ehemals Facebook). Bereits heute verfügen sie und einige weitere Unternehmen über besonders große Datensammlungen. Der zunehmende Einsatz von KI könnte den Trend zur Konzentration verstärken. Damit verstärken sich auch wirtschaftliche Abhängigkeiten und die Macht einzelner Unternehmen wächst.

Diese Zusammenhänge zwischen KI-Einsatz, Datensammlung und Macht sind nicht allein auf die Wirtschaft beschränkt. Auch Sicherheitsbehörden setzen zunehmend KI ein, um Risiken zu bewerten und Gefahren abzuwehren. In autoritären Staaten kann dies Überwachung und staatliche Repression verstärken.

Aber auch in Demokratien können Konflikte auftreten. Ein Beispiel: In den USA wird diskutiert, ob die Nutzung von Zyklus-Apps für Frauen zum Risiko werden könnte. Denn Abtreibung gilt in vielen Bundesstaaten wieder als illegal, seit der Supreme Court 2022 entschieden hat, dass aus der Verfassung kein Recht auf Schwangerschaftsabbruch abgeleitet werden kann. Unter Umständen könnten Zyklus-Daten als Hinweise auf eine Abtreibung gewertet werden. Es ist unklar, ob der Schutz der persönlichen Daten gewährleistet werden kann oder ob sie ausgewertet werden könnten, um illegale Abtreibungen zu verfolgen.

Der kleine Datentest

Du, deine Zahnbürste & dein grauer Alltag: Welche Daten produzieren wir im Laufe eines Tages? Welche Folgen hat das?

„Der kleine Datentest“ deckt auf.

Eine Frage von Macht: Wer profitiert von KI?

KI-Technologie kann ein mächtiges Werkzeug sein und wirtschaftlichen Nutzen bringen. Die Frage ist, für wen. Insbesondere einige Internet-Konzerne könnten noch einflussreicher werden und ihre Gewinne steigern. KI könnte auch von Regierungen oder politischen Interessengruppen genutzt werden, um mehr Macht zu erlangen beziehungsweise zu festigen – zum Beispiel durch die Beeinflussung der öffentlichen Meinung in sozialen Netzwerken, wie der Skandal um Cambridge Analytica im US-Wahlkampf 2016 gezeigt hat. KI wird dementsprechend oft als Risiko für die Demokratie betrachtet. Umgekehrt könnte man fragen: Was wäre aus Sicht einer demokratischen Gesellschaft gut? Wie könnten wir den Einsatz von KI so regeln, dass die Gesellschaft insgesamt davon profitiert?

Mehr dazu siehe Was können wir tun?

Serie: Blackbox

Daten, Daten, Daten: Sie werden gesammelt, ausgewertet und so zu „Big Data“. Filme streamen, Fitnessarmbänder tragen, E-Books lesen, Auto fahren – alles und noch viel mehr erzeugt Daten. Wo wir gehen oder stehen, erzeugen wir eine Datenspur – nicht immer freiwillig.

Doch wer sammelt und kontrolliert diese Daten? Wozu werden sie genutzt? Zu diesem großen Thema finden Sie hier drei Kurzvideos.

Mehr erfahren: Fallbeispiele und Linktipps

- „Digital bias – Auch Computerprogramme können rassistisch sein“, Podcast Feuer & Brot (monatlich erscheinender Podcast mit Themen von Politik bis Popkultur)

- Fluch und Segen der Künstlichen Intelligenz, SWR Doku auf YouTube

- Arbeit aus dem Automaten, Bericht über Österreich in der Süddeutschen Zeitung